Il rapido progresso della tecnologia e professionale servizi di automazione dei processi aziendali hanno portato vantaggi innegabili come maggiore efficienza, riduzione dei costi e miglioramento della produttività. Tuttavia, in generale, quando l’automazione diventa più diffusa, le implicazioni etiche di queste tecnologie devono essere attentamente considerate.

Quali sono i dilemmi etici che nascono dall’automazione? Come possiamo garantire equità e responsabilità in un mondo sempre più automatizzato? Questo blog approfondirà l’etica dell’automazione, le sfide che presenta e l’importanza di affrontare questi problemi in modo ponderato.

Vuoi automatizzare i tuoi processi senza compromettere l’etica e l’equità?

Che cos’è l’automazione dei processi e come entra in gioco l’etica?

L’automazione dei processi si riferisce all’uso della tecnologia per eseguire compiti ripetitivi, tradizionalmente svolti dagli esseri umani, senza la necessità di un costante intervento umano. Da automazione dei processi robotici (RPA) nelle operazioni aziendali a intelligenza artificiale (AI) e apprendimento automatico sviluppo e algoritmi nel processo decisionale, l’automazione è diventata un punto di svolta.

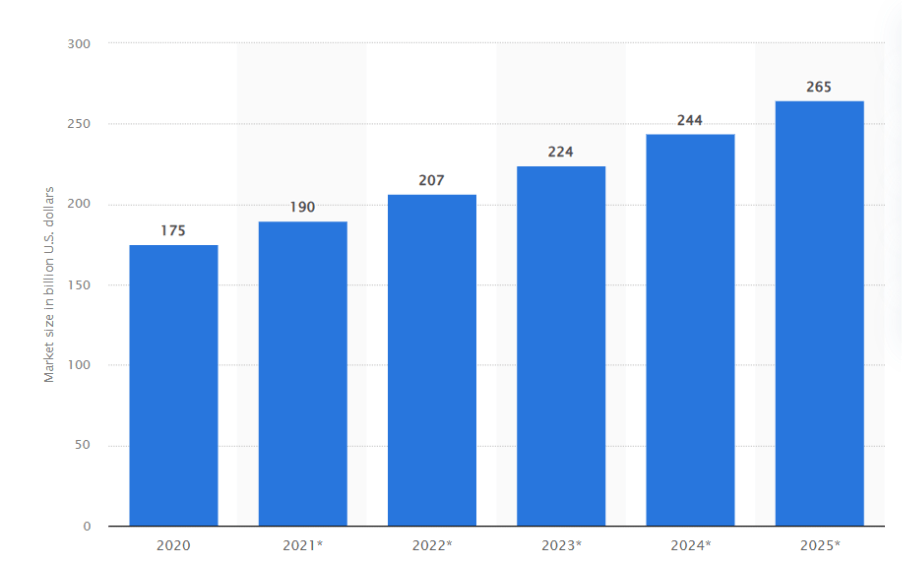

Statista afferma che il mercato globale dell’automazione industriale, valutato a circa 175 miliardi di dollari nel 2020, è pronto per un’espansione significativa. Si prevede che questo mercato crescerà a un tasso di crescita annuale composto (CAGR) di circa il 9%, raggiungendo livelli impressionanti 265 miliardi di dollari entro il 2025. Questa crescita sostanziale sottolinea la crescente adozione di tecnologie di automazione in vari settori in tutto il mondo.

Fonte: Statista he Mercato globale dell’automazione industriale – Dal 2020 al 2025

Sebbene l’automazione sia vista come uno strumento per migliorare la produttività, ridurre l’errore umano e semplificare i processi, solleva importanti questioni etiche. Poiché le macchine assumono sempre più compiti, come possiamo garantire che vengano utilizzate in modo responsabile? L’etica dell’automazione implica considerare l’impatto della tecnologia sull’occupazione, l’equità, i pregiudizi, la responsabilità e la dignità umana.

Bias ed equità nei sistemi automatizzati

Una delle preoccupazioni principali nell’etica dell’automazione è il potenziale di bias nei sistemi automatizzati. Gli algoritmi di intelligenza artificiale, se non adeguatamente testati o addestrati, possono perpetuare e persino amplificare i pregiudizi esistenti nella società. Questi pregiudizi spesso derivano da dati errati o incompleti, che portano a processi decisionali ingiusti in settori critici come assunzioni, prestiti e assistenza sanitaria.

L’importanza di test diversificati nello sviluppo di modelli di intelligenza artificiale

Per mitigare i pregiudizi, è essenziale utilizzare test diversificati nello sviluppo di modelli di intelligenza artificiale. Esponendo questi modelli a un’ampia gamma di scenari, lingue, contesti culturali ed esempi del mondo reale, le organizzazioni possono identificare ed eliminare i pregiudizi prima dell’implementazione. Ad esempio:

- Test su gruppi demografici: Garantire che i sistemi di intelligenza artificiale non favoriscano un gruppo rispetto a un altro.

- Incorporare lingue e contesti culturali diversi: I sistemi di intelligenza artificiale dovrebbero essere testati in vari contesti per identificare potenziali pregiudizi culturali.

Processi di qualità dei dati e de-biasing nei sistemi di intelligenza artificiale

La qualità dei dati svolge un ruolo cruciale nell’affrontare i pregiudizi nei sistemi di intelligenza artificiale. Distorsioni nei dati di addestramento, come la sottorappresentazione di determinati gruppi demografici, possono portare a risultati distorti. Alcune strategie per affrontare questo problema includono:

- Curare diversi set di dati: Assicurarsi che tutti i gruppi siano equamente rappresentati nei dati di addestramento.

- Implementazione di tecniche di de-biasing: Utilizza algoritmi per identificare e correggere le distorsioni nei dati prima che vengano utilizzati nei modelli di intelligenza artificiale.

Sistemi di feedback che riconoscono la diversità nelle interazioni con l’intelligenza artificiale

Incorporare sistemi di feedback che riconoscano e si adattino alle diverse interazioni degli utenti è un altro passo verso la garanzia di risultati di intelligenza artificiale equi. Alcuni modi per integrare i meccanismi di feedback includono:

- Raccolta del feedback degli utenti: Raccogli continuamente feedback dagli utenti di diversi dati demografici.

- Adattamento alle interazioni dell’utente: Utilizza il feedback per adattare i modelli di intelligenza artificiale e affrontare eventuali pregiudizi che potrebbero sorgere.

Preoccupato per i pregiudizi nell’automazione basata sull’intelligenza artificiale? Pronti per soluzioni più intelligenti ed eque?

Considerazioni etiche nell’automazione

Le considerazioni etiche nell’automazione sono molteplici e coinvolgono sia l’etica proscrittiva che quella prescrittiva. L’etica prescrittiva implica evitare danni prevenendo conseguenze negative, come la discriminazione o l’invasione della privacy, mentre l’etica prescrittiva incoraggia azioni positive, come la promozione del benessere e dell’equità.

Etica proscrittiva e prescrittiva nell’automazione

Nel contesto dell’automazione dei processi, l’etica proscrittiva enfatizza l’evitare pratiche dannose come processi decisionali distorti o spostamenti di posti di lavoro senza adeguate garanzie. L’etica prescrittiva, d’altro canto, sollecita l’uso dell’automazione per promuovere l’equità, aumentare la soddisfazione sul lavoro e migliorare l’accessibilità. I quadri etici guidano l’automazione aiutando le aziende ad allineare le loro pratiche con gli standard morali, garantendo che la tecnologia serva gli interessi umani e non porti a danni involontari.

Il ruolo dell’etica nei processi decisionali nell’automazione

L’integrazione dei principi etici nei processi decisionali automatizzati è essenziale. I sistemi automatizzati dovrebbero essere progettati non solo per ottimizzare le prestazioni ma anche per aderire a linee guida etiche che riflettono i valori sociali. Ciò può essere ottenuto incorporando algoritmi etici e garantendo che le decisioni prese dai sistemi di intelligenza artificiale rispettino regole di equità, trasparenza e responsabilità.

Automazione socialmente responsabile e approcci incentrati sui dipendenti

Poiché l’automazione ha un impatto sempre maggiore su vari settori, le aziende devono adottare pratiche socialmente responsabili. Ciò implica considerare gli effetti dell’automazione sui dipendenti e sulla comunità più ampia. Le pratiche chiave includono:

- Fornire opportunità di riqualificazione: Garantire che i dipendenti possano passare a nuovi ruoli.

- Adottare piani di transizione equi: Creare strategie che supportino i lavoratori colpiti dall’automazione.

- Offrire sostegno ai lavoratori sfollati: Fornire servizi di collocamento lavorativo e pacchetti di fine rapporto.

Impatto sull’occupazione

Uno degli aspetti più dibattuti della automazione dei processi è il suo impatto sull’occupazione. Da un lato, l’automazione può portare allo spostamento di posti di lavoro, in particolare nelle industrie che dipendono dal lavoro manuale. D’altro canto, l’automazione può anche creare nuove opportunità consentendo ai lavoratori di concentrarsi su compiti più complessi e creativi, favorendo così l’innovazione.

Statistiche e previsioni sullo spostamento del lavoro

Secondo un rapporto del 2023 di McKinsey, l’automazione potrebbe spostare circa 400 milioni di posti di lavoro a livello globale entro il 2030. Tuttavia, lo stesso rapporto prevede anche che l’automazione potrebbe creare 500 milioni di nuovi posti di lavoro, anche se in settori diversi. Ciò evidenzia la duplice natura dell’impatto dell’automazione sull’occupazione: mentre alcuni posti di lavoro potrebbero andare persi, potrebbero emergere nuovi ruoli che richiedono competenze diverse.

La duplice natura dell’impatto dell’automazione sull’occupazione

L’automazione presenta sia sfide che opportunità per i lavoratori. Mentre alcuni lavori rischiano di essere automatizzati, altri richiederanno l’intervento e la supervisione umana. La chiave per gestire questa transizione è garantire che i lavoratori siano adeguatamente supportati attraverso programmi di riqualificazione e riqualificazione. L’automazione, se eseguita in modo responsabile, può portare a posti di lavoro migliori e a migliori condizioni sul posto di lavoro.

Coinvolgere i dipendenti nelle decisioni sullo spostamento del lavoro

Dal punto di vista etico, le aziende dovrebbero coinvolgere i dipendenti nelle decisioni sull’automazione, in particolare quando si tratta di spostamento del lavoro. Consultarsi con i dipendenti sulle iniziative di automazione garantisce che le loro preoccupazioni vengano affrontate e che siano trattati con dignità durante tutto il processo. Fornire supporto come pacchetti di fine rapporto, opportunità di riqualificazione e servizi di inserimento lavorativo può aiutare a mitigare gli effetti negativi dell’automazione sui lavoratori.

Progressi tecnologici e sfide etiche

Man mano che le tecnologie di intelligenza artificiale e automazione continuano ad avanzare, sorgono nuove sfide etiche. Ad esempio, l’automazione in settori come quello sanitario, finanziario e legale pone sfide uniche che richiedono linee guida etiche specifiche per settore. I quadri etici aiutano le aziende ad affrontare queste sfide, garantendo un processo decisionale responsabile e affidabile.

Quadri etici per l’intelligenza artificiale e l’automazione

I quadri etici sono essenziali per guidare l’uso responsabile dell’intelligenza artificiale e dell’automazione. L’etica proscrittiva e prescrittiva sono componenti chiave per garantire che i sistemi automatizzati non danneggino gli individui o la società, promuovendo al contempo risultati positivi. Ad esempio, i modelli di intelligenza artificiale devono essere progettati con procedure decisionali etiche che prevengano danni e diano priorità all’equità. Questi quadri sono sempre più critici in quanto tecnologie come gli agenti commerciali autonomi o gli algoritmi per gli incidenti operano in ambienti ad alto rischio, dove le decisioni devono allinearsi ai valori sociali e agli standard legali.

Responsabilità e negligenza nei sistemi di intelligenza artificiale

Una delle domande più urgenti nell’etica dell’automazione è chi è responsabile quando le cose vanno male. Negli scenari che coinvolgono veicoli autonomi o sistemi sanitari basati sull’intelligenza artificiale, la responsabilità è spesso oscura. Il dilemma sociale dei veicoli autonomi – ad esempio se debbano dare priorità alla vita dei passeggeri rispetto a quella dei pedoni – richiede un’attenta considerazione etica. Se la negligenza nella programmazione o nella progettazione dovesse causare danni, la società dietro l’intelligenza artificiale deve essere ritenuta responsabile. Tuttavia, la teoria robotica della mente – la capacità dell’intelligenza artificiale di comprendere e rispondere alle intenzioni umane – potrebbe complicare queste discussioni, rendendo più difficile determinare chi è in colpa.

Sfide etiche in diversi settori utilizzando l’intelligenza artificiale

Settori come quello sanitario, finanziario e legale presentano sfide etiche uniche. Ad esempio, nella regolamentazione dei dispositivi medici, le implicazioni etiche dell’utilizzo di tecnologie mediche basate sull’intelligenza artificiale per prendere decisioni diagnostiche sono vaste. È fondamentale che gli sviluppatori di tali sistemi adottino un quadro etico interculturale per garantire l’equità e l’accuratezza del trattamento tra le diverse popolazioni di pazienti. I vettori di bias nei dati di addestramento possono portare a diagnosi o trattamenti errati, colpendo in modo sproporzionato i gruppi minoritari.

Ad esempio, nella finanza, l’ascesa di agenti commerciali autonomi può introdurre rischi di manipolazione e instabilità del mercato. Le preoccupazioni etiche devono essere affrontate con una procedura dal basso verso l’alto che incoraggi la trasparenza nel ruolo dell’intelligenza artificiale in questi sistemi, prevenendo lo sfruttamento da parte di entità potenti. Al contrario, la spinta del settore finanziario per una rapida adozione dell’IA può portare a un lavaggio etico, in cui le aziende rivendicano un utilizzo etico dell’IA senza azioni significative.

Confini responsabili nello sviluppo dell’intelligenza artificiale

Stabilire limiti responsabili nello sviluppo dell’IA è essenziale per evitare trappole etiche. Ciò implica garantire che i sistemi di intelligenza artificiale non operino oltre l’ambito o la funzione previsti, il che è fondamentale per mantenere la fiducia del pubblico. Ad esempio, i sistemi di intelligenza artificiale utilizzati nei servizi pubblici dovrebbero essere soggetti a un processo dall’alto verso il basso che garantisca che operino entro confini etici, legali e sociali.

Come questi tecnologie evolvono, le aziende e le autorità di regolamentazione devono continuamente affinare il loro approccio all’automazione e all’etica dell’intelligenza artificiale. Solo attraverso un’azione responsabile e ponderata possiamo garantire che i progressi tecnologici avvantaggino la società senza causare danni.

Trasparenza e responsabilità

Uno degli aspetti più importanti dell’automazione dei processi è garantire trasparenza e responsabilità nei sistemi automatizzati. Senza trasparenza, gli utenti non possono fidarsi del sistema e senza responsabilità, errori o pregiudizi possono rimanere incontrollati.

Importanza dell’intelligenza artificiale spiegabile (XAI) per la trasparenza

IA spiegabile (XAI) è un concetto che consente agli utenti di comprendere come i sistemi di intelligenza artificiale prendono decisioni. Fornendo spiegazioni chiare e comprensibili per le decisioni automatizzate, XAI promuove la fiducia e la responsabilità. Questa trasparenza è fondamentale per garantire che i sistemi automatizzati rimangano etici e siano in linea con i valori sociali.

Meccanismi di feedback continuo

I meccanismi di feedback continuo sono essenziali per garantire la responsabilità nei sistemi automatizzati. Raccogliendo regolarmente feedback dagli utenti e analizzando le prestazioni del sistema, le organizzazioni possono perfezionare i propri modelli per garantire che continuino a operare in modo equo ed etico. I cicli di feedback aiutano a garantire che i sistemi rimangano adattabili e reattivi alle esigenze degli utenti.

Integrazione delle competenze umane nell’automazione

Sebbene l’automazione possa migliorare l’efficienza, le competenze umane rimangono vitali per garantire che i sistemi di intelligenza artificiale funzionino in modo etico. La supervisione umana può colmare le lacune tecnologiche, garantendo che i sistemi rimangano allineati ai valori umani e agli standard etici. Integrando le competenze umane, le aziende possono garantire la responsabilità nei sistemi automatizzati.

Vuoi automatizzare i processi garantendo al tempo stesso l’etica?

Poiché l’automazione continua a plasmare il futuro del lavoro, è fondamentale bilanciare i suoi benefici con considerazioni etiche. Le aziende devono adottare strategie che diano priorità all’equità, alla trasparenza e alla responsabilità, riducendo al minimo i potenziali danni.

Aziende come WeblineIndia, con il loro Modello di outsourcing di RelyShore, dimostrano che è possibile automatizzare i processi in modo etico ed efficace. Puoi costruire un futuro in cui la tecnologia sia al servizio dell’umanità, promuova l’uguaglianza e favorisca l’innovazione garantendo che i principi etici siano al centro dell’automazione.

Hashtag sociali

#AutomazioneDeiProcessi #AutomazioneEtica #EticaAziendale #BuonePraticheDiAutomazione #IAeEtica #AutomazioneResponsabile #TecnologiaPerIlBene #StrategiaDiAutomazione #WeblineIndia

Sei pronto a trovare un equilibrio tra efficienza ed etica per rendere il tuo percorso verso l’automazione davvero di grande impatto?

Domande frequenti

Testimonianze: ascoltale direttamente dai nostri clienti globali

I nostri processi di sviluppo offrono soluzioni dinamiche per affrontare le sfide aziendali, ottimizzare i costi e guidare la trasformazione digitale. Soluzioni supportate da esperti migliorano la fidelizzazione e la presenza online, mentre casi di successo comprovati evidenziano la risoluzione di problemi reali tramite applicazioni innovative. I nostri stimati clienti in tutto il mondo lo hanno già sperimentato.

Premi e Riconoscimenti

Sebbene i clienti soddisfatti siano la nostra più grande motivazione, il riconoscimento del settore ha un valore significativo. WeblineIndia è stata costantemente leader nella tecnologia, con premi e riconoscimenti che riaffermano la nostra eccellenza.

OA500 Aziende globali di outsourcing 2025, di Outsource Accelerator

Migliore azienda di sviluppo software, di GoodFirms

Migliore azienda di soluzioni fintech – 2022, di GESIA

Premiata come – Migliore azienda di sviluppo app in India 2020, da SoftwareSuggest